10 Tendances Kubernetes qui Redéfiniront le Cloud en 2026

Par Anthony Marchand

1 avril 2026

Points clés à retenir :

- L'adoption de Kubernetes devrait atteindre des sommets, devenant le standard absolu pour 80% des entreprises.

- L'Intelligence Artificielle et le Machine Learning sont les nouveaux moteurs principaux des déploiements K8s.

- L'ingénierie de plateforme (Platform Engineering) vient remplacer le DevOps traditionnel pour réduire la charge mentale des développeurs.

- L'Edge Computing et l'émergence de WebAssembly ouvrent de toutes nouvelles frontières pour l'orchestration décentralisée.

L'évolution du paysage cloud

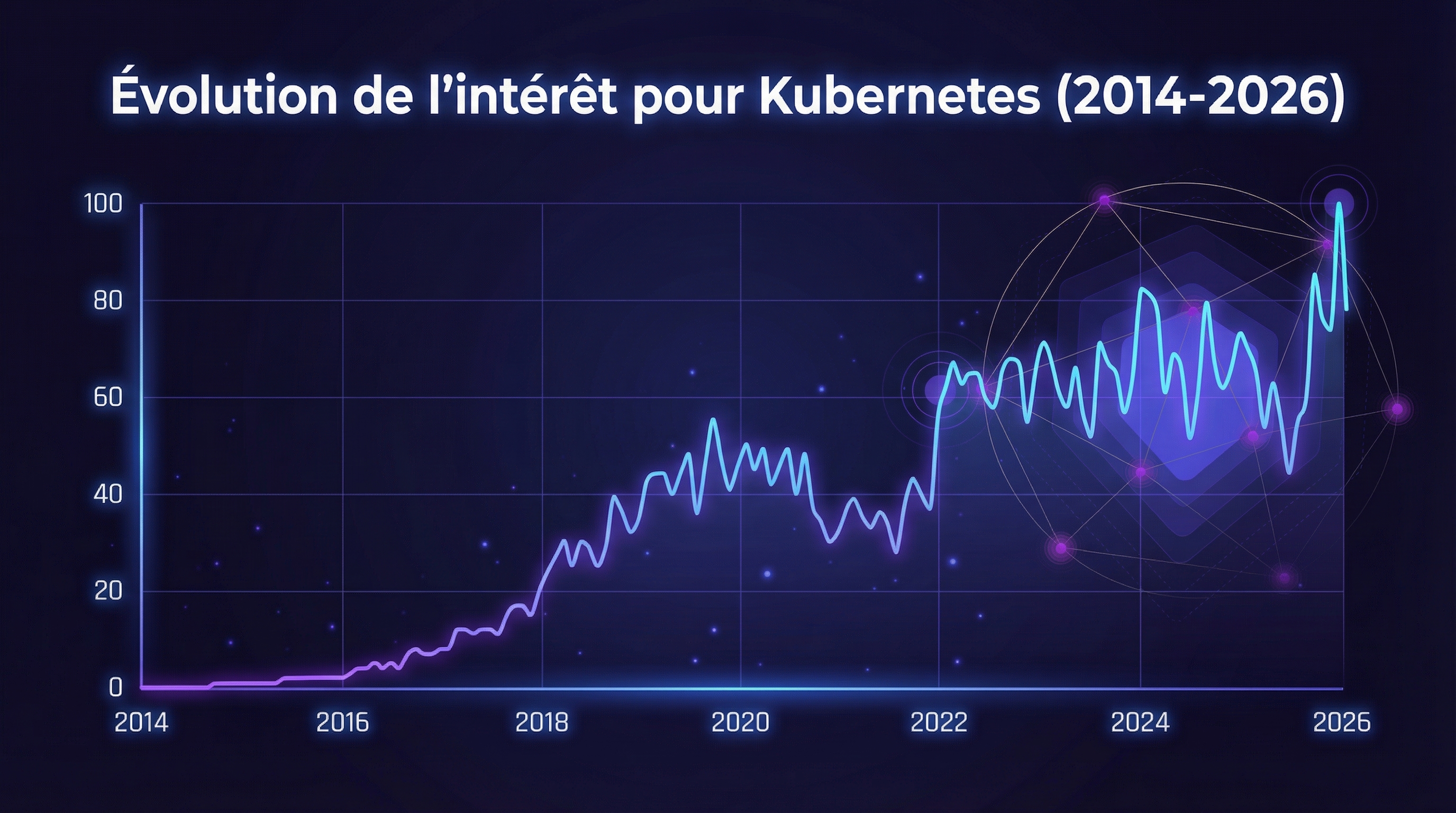

Le Cloud Computing traverse une phase de maturité fascinante. Kubernetes, qui a récemment soufflé sa dixième bougie, n'est plus ce projet open source expérimental réservé à une poignée d'experts. C'est devenu l'épine dorsale de l'infrastructure numérique mondiale. En 2026, la question n'est plus de savoir si vous devez utiliser Kubernetes, mais comment l'optimiser face à de nouveaux cas d'usage extrêmes via un service d'infogérance Kubernetes sur-mesure.

Les défis de la complexité

Malgré sa puissance, l'orchestrateur apporte une complexité indéniable. Les équipes d'ingénierie de plateforme doivent jongler avec la sécurité, les coûts explosifs et des architectures distribuées tentaculaires. Les tendances de 2026 sont une réponse directe à ces défis : simplifier l'expérience, sécuriser par défaut, et maîtriser les budgets.

Alors que nous nous projetons vers 2026, l'écosystème cloud-native entame une mutation sans précédent. L'époque des simples applications web stateless laisse place à une ére dominée par l'intelligence artificielle, la décentralisation massive et l'automatisation cognitive. Pour répondre aux défis de complexité évoqués précédemment, les organisations doivent s'approprier de nouveaux paradigmes. Voici une analyse approfondie des 10 tendances majeures qui redessinent actuellement les contours de l'orchestration et du Cloud Computing.

1. L'Intelligence Artificielle et le Machine Learning au Cœur des Clusters

L'une des tendances les plus colossales pour 2026, c'est sans conteste la fusion entre Kubernetes et l'Intelligence Artificielle. Aujourd'hui, on ne déploie plus seulement de simples microservices ; on orchestre des modèles d'apprentissage profond et des pipelines de données complexes. C'est fou de se dire que 90 % des utilisateurs s'attendent à voir leurs workloads IA et Machine Learning augmenter sur Kubernetes.

Pourquoi un tel engouement ? Parce que l'IA a besoin de flexibilité et de puissance à la demande. Kubernetes excelle dans ce domaine en gérant l'allocation dynamique des ressources GPU, ce qui est vital pour entraîner des modèles LLM sans gaspiller de l'argent.

- Allocation intelligente des GPU : K8s attribue la puissance de calcul exactement là où le modèle en a besoin, évitant la sous-utilisation du matériel.

- Scalabilité horizontale : Parfait pour gérer les pics de trafic lors de l'inférence des modèles en production, passant de 1 à 1000 pods en un éclair.

- Résilience : Les capacités d'auto-réparation garantissent que vos pipelines de données ne s'interrompent jamais en plein calcul.

En 2026, Kubernetes n'est plus seulement un orchestrateur de conteneurs, c'est devenu le système d'exploitation par défaut de l'Intelligence Artificielle.

2. L'Essor Inévitable du Platform Engineering

Adieu le DevOps traditionnel où chaque développeur devait jongler avec des dizaines d'outils d'infrastructure complexes. Bonjour le Platform Engineering ! La complexité croissante de Kubernetes a poussé les entreprises à créer des "Internal Developer Platforms" (IDP). L'objectif est simple : cacher la complexité sous le capot et offrir aux développeurs un portail en libre-service intuitif.

En 2026, on estime que 80 % des organisations auront adopté cette approche, contre seulement 45 % quelques années plus tôt. L'idée n'est pas de brider les développeurs, mais de réduire drastiquement leur charge cognitive.

- Automatisation des standards : Les équipes d'ingénierie de plateforme préconfigurent les environnements avec les bonnes pratiques de sécurité intégrées.

- Gain de temps massif : Fini les tickets au support IT pour obtenir un cluster de test, tout est automatisé.

- Centralisation : Les développeurs se concentrent enfin sur ce qu'ils aiment : écrire du code qualitatif, pendant que la plateforme gère la plomberie.

Cette tendance est salvatrice pour les entreprises qui peinaient à trouver des experts K8s sur le marché de l'emploi.

3. FinOps et GreenOps : L'Optimisation Devient Maîtresse

L'époque de la croissance à tout prix où l'on provisionnait des serveurs sans regarder la facture est révolue. Le gaspillage dans le cloud dépasse allègrement les 21 milliards de dollars par an. En 2026, le FinOps (Financial Operations) est parfaitement intégré aux workflows Kubernetes. Les entreprises veulent savoir exactement quel microservice ou quelle équipe consomme le budget pour mettre en place des actions concrètes afin de réduire les coûts de vos clusters Kubernetes.

Parallèlement, le GreenOps monte en puissance. Suivre ses coûts, c'est bien, mais suivre son empreinte carbone, c'est devenu une obligation stratégique et réglementaire pour les grandes entreprises. On commence à voir des autoscalers conscients de leur empreinte carbone, capables de déplacer des workloads vers des régions géographiques alimentées en énergie renouvelable.

Pour vous donner une idée plus claire des outils qui dominent ce secteur, voici un comparatif des outils FinOps entre Kubecost et OpenCost.

| Caractéristique | OpenCost | Kubecost |

|---|---|---|

| Modèle et Licence | Projet Open source (CNCF) | Produit commercial (basé sur OpenCost) |

| Fonctionnalités clés | Calcul des coûts de base (CPU, RAM, GPU) | Gouvernance avancée, alertes, recommandations |

| Public idéal | Petites équipes, budgets très limités | Grandes entreprises, environnements multi-cloud complexes |

L'adoption de ces outils permet de passer d'une posture réactive à une gestion proactive et intelligente des budgets cloud.

4. L'Expansion Frontale vers l'Edge Computing

L'Edge Computing consiste à rapprocher la puissance de calcul au plus près de l'endroit où les données sont générées (usines, véhicules autonomes, magasins). Avec les prévisions indiquant que 75 % des données d'entreprise seront traitées "à la périphérie", Kubernetes a dû subir une sacrée cure d'amincissement pour s'adapter.

Les distributions lourdes classiques ne fonctionnent pas sur un petit capteur IoT ou un serveur de supermarché mal ventilé. C'est ici que brillent les distributions ultra-légères en 2026. Ces versions épurées nécessitent très peu de RAM et de CPU tout en conservant la magie déclarative de K8s.

| Distribution | Éditeur Principal | Spécificité et Cas d'usage |

|---|---|---|

| K3s | Rancher (SUSE) | Idéal pour l'IoT, remplace etcd par SQLite, extrêmement léger |

| MicroK8s | Canonical | Parfait pour les écosystèmes Ubuntu, installation simple via Snap |

| K0s | Mirantis | Focus sur la sécurité (100% FIPS), binaire unique facile à distribuer |

Comme le souligne ce comparatif des implémentations K8s légères, que ce soit K3s ou K0s, ces outils permettent de gérer des milliers de clusters distribués aux quatre coins du globe depuis un point de contrôle central unique.

5. La Révolution Discrète du Serverless Kubernetes

Associer le mot "Serverless" et "Kubernetes" peut paraître paradoxal. Après tout, K8s est célèbre pour sa gestion pointue des nœuds et de l'infrastructure subjacente. Pourtant, en 2026, le Serverless Kubernetes s'impose comme une évidence. Les développeurs veulent simplement déployer leur code sans jamais avoir à configurer un seul Worker Node.

Des technologies comme Knative ou OpenFaaS, combinées aux offres managées des fournisseurs cloud, permettent de faire tourner des fonctions éphémères directement sur un cluster.

- Mise à l'échelle à zéro (Scale-to-zero) : Si votre application ne reçoit aucun trafic, elle ne consomme absolument aucune ressource. C'est magique pour le portefeuille.

- Paiement à l'usage réel : On sort du paradigme où l'on paie pour des serveurs qui dorment la nuit.

- Idéal pour l'IA : L'inférence de modèles capricieux s'accommode parfaitement de cette architecture élastique.

C'est une aubaine pour les startups qui veulent la puissance de K8s sans embaucher une armée d'administrateurs système.

6. La Sécurité "Zero Trust" et la Révolution eBPF

La sécurité cloud-native n'est plus une réflexion après coup. Face à l'explosion des cyberattaques et des vulnérabilités complexes, les entreprises en 2026 adoptent massivement des architectures "Zero Trust" (ne faire confiance à personne, vérifier en permanence).

Mais la vraie star technique de cette sécurité repensée, c'est l'eBPF (Extended Berkeley Packet Filter). Pour faire simple, cette technologie permet d'exécuter des programmes de sécurité très rapides et isolés directement dans le noyau Linux, sans avoir à modifier le code source du noyau ou ajouter des modules lourds.

Jusqu'à présent, pour surveiller le trafic dans K8s, on utilisait des "sidecars" (des conteneurs supplémentaires greffés à chaque application), ce qui ralentissait tout. L'eBPF supprime ce besoin. Il offre une visibilité instantanée, permet de bloquer des comportements suspects en temps réel, et améliore drastiquement les performances réseau. C'est une avancée monumentale pour sécuriser les clusters sans sacrifier la vélocité des développeurs.

7. La Gestion Multi-Clusters et le Fléau des "Noisy Neighbors"

Fini le temps où une entreprise mettait tous ses œufs dans le même panier avec un gigantesque cluster monolithique. En 2026, la norme est au déploiement multi-clusters et au cloud hybride. Pourquoi ? Principalement pour des raisons de résilience et de conformité légale (souveraineté des données) et pour éviter le syndrome du "voisin bruyant" (noisy neighbor).

Imaginez une application gourmande qui monopolise toutes les ressources du cluster, faisant crasher les autres applications critiques à côté. En isolant les workloads dans des clusters distincts par département ou par zone géographique, on élimine ce risque.

Des outils de "Fleet Management" (gestion de flotte) comme Azure Arc ou Rancher permettent de superviser des dizaines, voire des centaines de clusters répartis entre AWS, Google Cloud, et vos propres datacenters locaux, le tout depuis un tableau de bord unique et avec une API unifiée. C'est la garantie ultime contre le verrouillage propriétaire (vendor lock-in).

8. Le GitOps Devient la Norme Absolue

Déployer à la main ou via de vieux scripts obscurs ? C'est de l'histoire ancienne. En 2026, le GitOps est la méthode reine pour gérer Kubernetes. Le concept est d'une élégance rare, s'appuyant sur les principes de l'Infrastructure as Code : votre dépôt Git (comme GitHub ou GitLab) devient la seule et unique source de vérité de votre infrastructure.

Concrètement, des outils comme ArgoCD ou Flux surveillent en permanence votre dépôt Git. Si un ingénieur modifie un fichier de configuration pour ajouter un serveur, l'outil détecte le changement et l'applique instantanément sur le cluster, garantissant une auditabilité parfaite et une lutte efficace contre le "Drift".

- Auditabilité parfaite : On sait exactement qui a modifié quoi et quand.

- Rollback immédiat : Si une mise en production plante, il suffit d'annuler le commit (git revert) pour que le cluster revienne à son état précédent sain.

- Lutte contre le "Drift" : Si quelqu'un modifie manuellement le cluster en secret, le système GitOps va l'écraser pour forcer le retour à l'état décrit dans Git.

C'est une approche qui apporte une sérénité incroyable aux équipes opérationnelles.

9. L'Intégration Grandissante de WebAssembly (Wasm)

Si vous n'avez pas encore entendu parler de WebAssembly (Wasm) dans le contexte du cloud, accrochez-vous. Initialement créé pour faire tourner du code haute performance dans les navigateurs web, Wasm est en train de bousculer l'écosystème Kubernetes en 2026.

Attention, Wasm ne va pas remplacer les conteneurs Docker traditionnels, il vient plutôt s'imposer comme un partenaire redoutable. Un module WebAssembly est incroyablement plus léger et sécurisé qu'un conteneur Linux classique. Il démarre en quelques millisecondes, là où un conteneur lourd peut prendre plusieurs secondes.

Pour les cas d'usage liés au Serverless ou à l'Edge Computing (où la bande passante et la mémoire sont limitées), déployer des modules Wasm orchestrés par Kubernetes est devenu une pratique ultra-performante. Cela permet d'obtenir des temps de réponse fulgurants tout en conservant l'écosystème et l'API familière de K8s.

10. Les Workloads Stateful et l'Unification avec les Machines Virtuelles

Historiquement, Kubernetes ha été imaginé pour du "stateless", c'est-à-dire des applications qui ne conservent aucune donnée persistante. Les bases de données devaient rester bien sagement à l'extérieur du cluster sur des machines virtuelles (VM) dédiées. En 2026, ce dogme est tombé.

La maturité des interfaces de stockage (CSI) permet aujourd'hui aux entreprises d'exécuter de lourdes bases de données ou des systèmes de cache directement dans K8s en toute confiance. Plus fort encore : la frontière entre conteneurs et machines virtuelles disparaît.

Des projets innovants comme KubeVirt permettent de gérer des VMs existantes exactement comme s'il s'agissait de pods Kubernetes. Pour une entreprise qui adopte des stratégies de migration vers le cloud-native pour ses vieilles applications monolithiques, c'est le Graal absolu. On unifie l'infrastructure, on réduit les coûts de licences tierces, et on pilote tout l'IT depuis une seule interface.

Conclusion

L'année 2026 marque un tournant définitif pour Kubernetes. Il ne s'agit plus simplement d'orchestrer de petits conteneurs web. K8s est devenu une plateforme d'infrastructure universelle, intelligente et hautement distribuée.

L'infusion de l'Intelligence Artificielle modifie fondamentalement la manière dont les ressources sont allouées, tandis que l'Edge Computing pousse la technologie au-delà des datacenters traditionnels. Dans le même temps, le Platform Engineering et des pratiques comme le GitOps ou le FinOps viennent rationaliser le quotidien des équipes techniques. Elles cachent la complexité, sécurisent les déploiements et optimisent des budgets cloud toujours plus serrés.

Si vous gérez des projets informatiques modernes, comprendre et adopter ces dix tendances n'est plus une option de luxe, c'est une question de survie technologique. Kubernetes a grandi, et il est grand temps de mettre vos stratégies à jour pour tirer parti de cette évolution fulgurante.

Anthony Marchand

Co-fondateur @ Log'in Line

Entrepreneur tech depuis 10 ans & amateur de cartes ♥️♣️♦️♠️

LinkedIn